Na crescente e frenética expansão da tecnologia contemporânea, não é apenas o avanço técnico que nos desafia, mas a urgência de compreender o que significa criar e conviver com máquinas que “pensam”. A inteligência artificial (IA) já deixou de ser uma promessa futurista; ela está integrada em serviços, negócios, governança pública e até nas nossas interações sociais diárias. Mas como podemos garantir que o seu desenvolvimento e uso sejam éticos, responsáveis e benéficos para toda a humanidade?

Se há uma pergunta que perpassa o discurso tecnológico atual, ela é esta:

Qual é o verdadeiro papel da ética quando a IA já não é apenas uma ferramenta, mas uma parceira ativa no processo decisório humano?

Essa pergunta não tem uma resposta simples — e essa é parte da sua importância.

Reflexões Iniciais: Como Definimos Ética em 2026?

Quando falamos em ética da IA, precisamos primeiro explorar: o que entendemos por ética? Não se trata apenas de evitar “coisas ruins”, como vieses ou discriminação. Ética envolve valores humanos, justiça, transparência, responsabilidade e respeito à dignidade humana. Na governança da IA, isso significa criar estruturas que assegurem que sistemas inteligentes operem de forma a respeitar direitos fundamentais, proteger a privacidade, promover a equidade e reforçar a confiança da sociedade. Esse arcabouço ético é um pilar para que a IA seja aceita socialmente e não se torne uma tecnologia ameaçadora ou injusta. (Wikipédia)

Mas por que insistimos tanto nessa discussão?

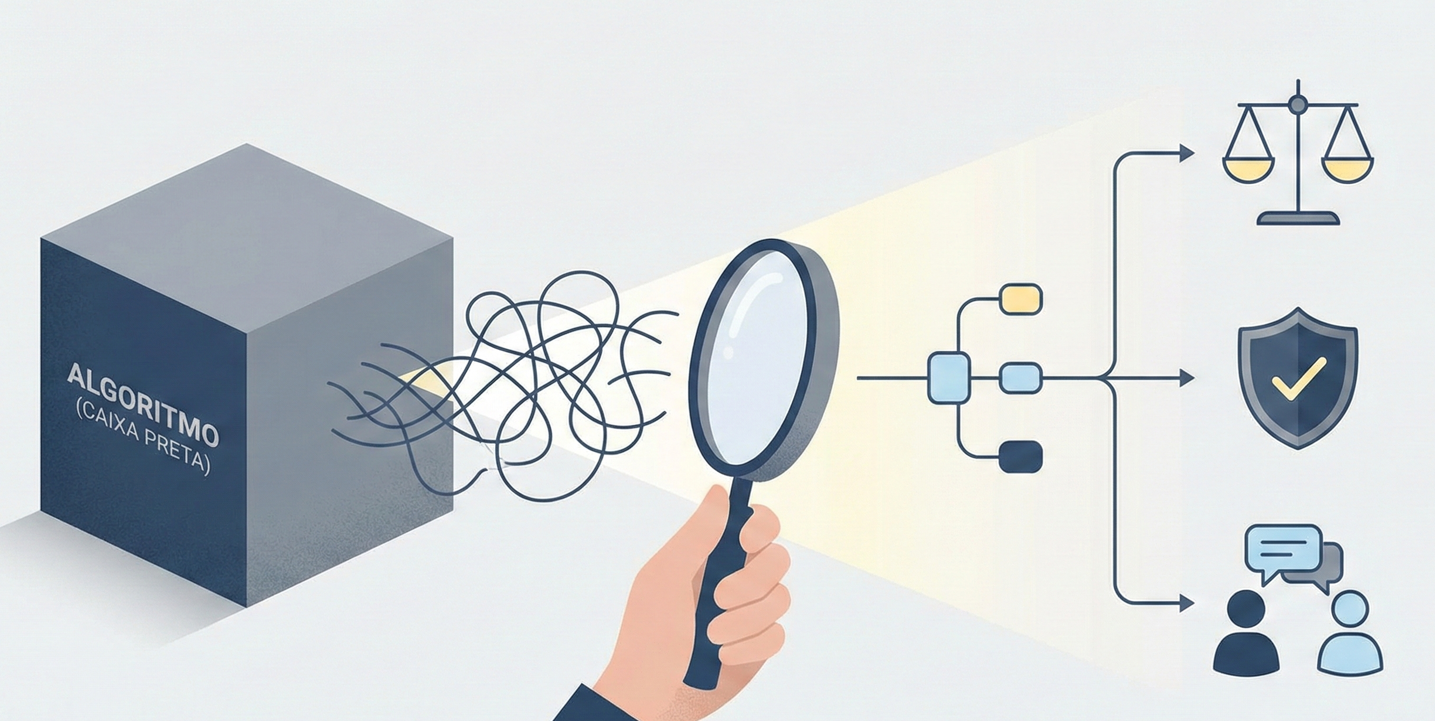

Imagine uma IA que decide quem recebe crédito, ou que classifica candidatos a emprego. Já aconteceu com você de ver uma decisão automatizada sobre um serviço e pensar: “Como essa máquina chegou a essa conclusão?” — e ninguém soube lhe dizer? Essa sensação de “caixa preta” não é trivial. Falta transparência quando não conseguimos entender as decisões da IA — e aí surge uma questão ética profunda. (Wikipédia)

O Paradoxo de Usar IA para Conduzir Pesquisa Ética

Outro ponto que merece nossa atenção é a própria utilização da IA em pesquisas que discutem ética da IA. Essa é uma situação paradoxal: estamos delegando atividades cognitivas complexas a algoritmos enquanto debatemos se essa delegação é ética. Estudos recentes argumentam que, sem supervisão humana rigorosa, confiar cegamente na IA para tarefas acadêmicas pode comprometer a integridade e a autenticidade da pesquisa científica — exatamente porque, muitas vezes, a própria IA não é transparente nem auditável. (Springer Nature Link)

Aqui cabe uma provocação pessoal:

Se a IA nos ajuda a escrever um artigo sobre ética da IA, quem é o verdadeiro autor? O humano? A máquina? Ambos?

Não é apenas uma questão semântica — tem implicações profundas na forma como entendemos autoria, criatividade, responsabilidade intelectual e confiança.

Tendências Éticas que Definirão 2026

Ao olharmos para o futuro próximo, 2026 aparece como um ponto crítico para consolidar práticas éticas na IA. Alguns temas serão particularmente centrais:

1. Transparência e Responsabilidade

A IA continuará a gerar resultados que impactam a vida de milhões de pessoas. Para além da eficiência, a sociedade exigirá clareza: como uma decisão foi tomada? Se uma IA nega um empréstimo, ou recomenda demissão, como justificamos isso? Há um movimento global para desenvolver estruturas e regimes regulatórios que tornem modelos mais explicáveis e auditáveis. (OUP Academic)

2. Combate a Desinformação e Deepfakes

A produção de conteúdo sintético (como deepfakes ou textos gerados automaticamente) está em ascensão. Em 2026, é esperado que governos e organizações avancem na regulamentação sobre rotulagem obrigatória de conteúdo gerado por IA e criminalização de deepfakes maliciosos. Isso significa que a ética passa a ser parte integrante do arcabouço legal, não apenas uma diretriz voluntária. (Bernard Marr)

3. Governança e Políticas Organizacionais

Empresas e instituições já não podem ignorar o impacto da IA. A implementação de políticas internas de uso responsável de IA será tão comum quanto políticas de privacidade de dados. Recursos Humanos, por exemplo, terão que educar funcionários sobre o uso ético da IA no ambiente de trabalho. (Bernard Marr)

4. Governança Global e Diversidade Cultural

A ética na IA não é universal — ela varia conforme valores culturais, prioridades de políticas públicas e sistemas jurídicos de cada país. Pesquisas mostram que, mesmo entre nações e instituições diferentes, os princípios éticos atribuídos à IA são interpretados de formas distintas. Isso levanta a necessidade de diálogo global, zelando por uma ética que respeite a diversidade, mas que seja eficaz em termos práticos. (Springer Nature Link)

Exemplificando o Complexo: Casos Reais e Hipotéticos

Caso 1: Viés Algorítmico em Sistemas de Seleção de Pessoal

Suponha que uma grande empresa utilize IA para classificar candidatos. Se os dados de treinamento refletirem desigualdades históricas da sociedade — como preferir um gênero, raça ou formação — isso se traduz em decisões injustas. O resultado não é apenas um algoritmo “imperfeito”; é a reprodução de padrões discriminatórios em escala massiva, algo que éticos e reguladores buscam mitigar fortemente. (Wikipédia)

Caso 2: Deepfakes e Democracia

Imagine um cenário eleitoral em que vídeos falsos (por IA) manipulam a opinião pública. A pergunta que se impõe é a seguinte:

Até que ponto a “liberdade de expressão” pode ser invocada quando o conteúdo é inteiramente fabricado por máquinas para enganar eleitores?

Esse problema transforma o que parecia um risco técnico numa ameaça real à estabilidade social, exigindo que a ética da IA seja combinada com justiça eleitoral e proteção da cidadania. (Bernard Marr)

O Papel da Sociedade: Não é Apenas Técnica, é Humana

Ao explorarmos essas tendências, vale lembrar que a ética não é um algoritmo — ela é uma prática social e política. Não há uma fórmula matemática que garanta um sistema 100% ético. Em vez disso, a ética exige diálogo, educação, governança transparente, diversidade de vozes e participação democrática.

Você já se perguntou:

Como eu, enquanto cidadão ou profissional, posso influenciar o desenvolvimento ético da IA?

Talvez a resposta esteja em educação contínua, participação em discussões públicas, colaboração com pesquisadores, engenheiros, legisladores e na exigência de transparência e responsabilidade por parte de corporações e governos.

Conclusão: O Que Esperar de 2026

Em 2026, a ética da IA deixará de ser um tema “especializado” e se tornará uma necessidade imperativa para todos os setores da sociedade:

- 📌 Regulamentações mais robustas irão moldar como IAs são desenvolvidas e aplicadas no mundo real. (OUP Academic)

- 📌 Transparência e explicabilidade serão mais valorizadas do que puro desempenho. (Wikipédia)

- 📌 Educação ética para usuários e desenvolvedores será cada vez mais essencial. (Bernard Marr)

- 📌 Debates culturais e globais variarão conforme valores, exigindo uma ética contextualizada e sensível às diferenças. (Springer Nature Link)

Levantar essas questões não é apenas importante — é urgente. Porque, se a tecnologia continua avançando, nós precisamos avançar tanto técnica quanto moralmente para garantir que ela nos eleve, não nos diminua.

Referências com Links

- Towards ethical evolution: responsible autonomy of artificial intelligence across generations (Springer) — Springer Nature Link

- The Paradox of Ethical AI-Assisted Research (Journal of Academic Ethics) — Springer Nature Link

- Examining trends in AI ethics across countries and institutions (AI & SOCIETY) — Springer Nature Link

- 8 AI Ethics Trends That Will Redefine Trust And Accountability In 2026 — Bernard Marr

- Ética na inteligência artificial (Wikipedia) — Wikipédia

- Engenharia de inteligência artificial (Wikipedia) — Wikipédia